# 使用Kubeadm快速搭建集群【v1.21】

kubeadm是官方社区推出的一个用于快速部署kubernetes集群的工具。

这个工具能通过两条指令完成一个kubernetes集群的部署:

# 创建一个 Master 节点

$ kubeadm init

# 将一个 Node 节点加入到当前集群中

$ kubeadm join <Master节点的IP和端口 >

# 1. 安装要求

在开始之前,部署Kubernetes集群机器需要满足以下几个条件:

- 一台或多台机器,操作系统 CentOS7.x-86_x64

- 硬件配置:2GB或更多RAM,2个CPU或更多CPU,硬盘30GB或更多

- 集群中所有机器之间网络互通

- 可以访问外网,需要拉取镜像

- 禁止swap分区

# 2. 准备环境

| 角色 | IP |

|---|---|

| liuxiaolu-master | 10.69.1.161 |

| liuxiaolu-node | 10.69.1.160 |

关闭防火墙:

$ systemctl stop firewalld

$ systemctl disable firewalld

关闭selinux:

$ sed -i 's/enforcing/disabled/' /etc/selinux/config # 永久

$ setenforce 0 # 临时

关闭swap:

$ swapoff -a # 临时

$ vim /etc/fstab # 永久

设置主机名:

$ hostnamectl set-hostname <hostname>

在master添加hosts:

$ cat >> /etc/hosts << EOF

10.69.1.161 liuxiaolu-master

10.69.1.160 liuxiaolu-node

EOF

将桥接的IPv4流量传递到iptables的链:

$ cat > /etc/sysctl.d/k8s.conf << EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

EOF

$ sysctl --system # 生效

时间同步:

$ yum install ntpdate -y

$ ntpdate time.windows.com

时间同步这一步可能会失败,我这里是重新设置了腾讯的yum源

$ mv /etc/yum.repos.d/CentOS-Base.repo /etc/yum.repos.d/CentOS-Base.repo.backup

$ wget -O /etc/yum.repos.d/CentOS-Base.repo http://mirrors.cloud.tencent.com/repo/centos7_base.repo

如果没有wget,可以先用yum安装wget

$ yum install wget

如果wget也安装不成功,可以在其他地方下载了yum源后上传到服务器上面去,上传命令如下,xx.xx.xx.xx为具体的服务器地址

$ scp CentOS-Base.repo root@xx.xx.xx.xx:~

设置好yum源后,记得更新缓存

$ yum clean all

$ yum makecache

# 3. 安装Docker/kubeadm/kubelet【所有节点】

Kubernetes默认CRI(容器运行时)为Docker,因此先安装Docker。

# 3.1 安装Docker

$ wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo

$ yum -y install docker-ce

$ systemctl enable docker && systemctl start docker

配置镜像下载加速器:

$ cat > /etc/docker/daemon.json << EOF

{

"registry-mirrors": ["https://b9pmyelo.mirror.aliyuncs.com"]

}

EOF

$ systemctl restart docker

$ docker info

# 3.2 添加阿里云YUM软件源

$ cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

# 3.3 安装kubeadm,kubelet和kubectl

由于版本更新频繁,这里指定版本号部署:

$ yum install -y kubelet-1.21.0 kubeadm-1.21.0 kubectl-1.21.0

$ systemctl enable kubelet

# 4. 部署Kubernetes Master

官网参考:

kubeadm-init#config-file (opens new window)

create-cluster-kubeadm#initializing-your-control-plane-node (opens new window)

在10.69.1.161(Master)执行。

$ kubeadm init \

--apiserver-advertise-address=10.69.1.161 \

--image-repository registry.aliyuncs.com/google_containers \

--kubernetes-version v1.21.0 \

--service-cidr=10.96.0.0/12 \

--pod-network-cidr=10.244.0.0/16 \

--ignore-preflight-errors=all

- --apiserver-advertise-address 集群通告地址

- --image-repository 由于默认拉取镜像地址k8s.gcr.io国内无法访问,这里指定阿里云镜像仓库地址

- --kubernetes-version K8s版本,与上面安装的一致

- --service-cidr 集群内部虚拟网络,Pod统一访问入口

- --pod-network-cidr Pod网络,与下面部署的CNI网络组件yaml中保持一致

或者使用配置文件引导:

$ vi kubeadm.conf

apiVersion: kubeadm.k8s.io/v1beta2

kind: ClusterConfiguration

kubernetesVersion: v1.21.0

imageRepository: registry.aliyuncs.com/google_containers

networking:

podSubnet: 10.244.0.0/16

serviceSubnet: 10.96.0.0/12

$ kubeadm init --config kubeadm.conf --ignore-preflight-errors=all

拷贝kubectl使用的连接k8s认证文件到默认路径:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

$ kubectl get nodes

NAME STATUS ROLES AGE VERSION

k8s-master Ready master 2m v1.18.0

# 5. 加入Kubernetes Node

在10.69.1.160(Node)执行。

向集群添加新节点,执行在kubeadm init输出的kubeadm join命令:

$ kubeadm join 10.69.1.161:6443 --token rq8cfq.did3y3h9ejsawbg1 \

--discovery-token-ca-cert-hash sha256:6e5fad79ecccd48604227447b14e809988e544a80c6aaa4dc95b0a8784b7059d

默认token有效期为24小时,当过期之后,该token就不可用了。这时就需要重新创建token,操作如下:

$ kubeadm token create

$ kubeadm token list

$ openssl x509 -pubkey -in /etc/kubernetes/pki/ca.crt | openssl rsa -pubin -outform der 2>/dev/null | openssl dgst -sha256 -hex | sed 's/^.* //'

63bca849e0e01691ae14eab449570284f0c3ddeea590f8da988c07fe2729e924

$ kubeadm join 192.168.31.61:6443 --token nuja6n.o3jrhsffiqs9swnu --discovery-token-ca-cert-hash sha256:63bca849e0e01691ae14eab449570284f0c3ddeea590f8da988c07fe2729e924

或者直接命令快捷生成:kubeadm token create --print-join-command

官网参考:kubeadm#kubeadm-join (opens new window)

# 6. 部署容器网络(CNI)

官网参考:create-cluster-kubead#pod-network (opens new window)

注意:只需要部署下面其中一个,推荐Calico。

- Calico是一个纯三层的数据中心网络方案,Calico支持广泛的平台,包括Kubernetes、OpenStack等。

- Calico 在每一个计算节点利用 Linux Kernel 实现了一个高效的虚拟路由器( vRouter) 来负责数据转发,而每个 vRouter 通过 BGP 协议负责把自己上运行的 workload 的路由信息向整个 Calico 网络内传播。

- 此外,Calico 项目还实现了 Kubernetes 网络策略,提供ACL功能。

官网参考:kubernetes-quickstart (opens new window)

$ wget https://docs.projectcalico.org/manifests/calico.yaml

下载完后还需要修改里面定义Pod网络(CALICO_IPV4POOL_CIDR),与前面kubeadm init指定的一样,即10.244.0.0/16

- 执行命令调整calico.yaml

$ vi calico.yaml

.....

- name: CALICO_IPV4POOL_CIDR

value: "10.244.0.0/16"

......

- 执行命令安装calico

$ kubectl apply -f calico.yaml

- 查看安装进度

$ kubectl get pods -n kube-system

为什么要部署calico网络,或者说网络组件解决了那些问题?

- 每个docker主机创建的容器ip可能冲突?

- 容器1访问容器2,容器1怎么知道容器2在哪个docker主机?

- 容器1访问容器2数据包怎么传输过去?

# 7. 测试kubernetes集群

- 验证Pod工作

- 验证Pod网络通信

- 验证DNS解析

在Kubernetes集群中创建一个pod,验证是否正常运行:

$ kubectl create deployment nginx --image=nginx

$ kubectl expose deployment nginx --port=80 --type=NodePort

$ kubectl get pod,svc

访问地址:http://NodeIP:Port

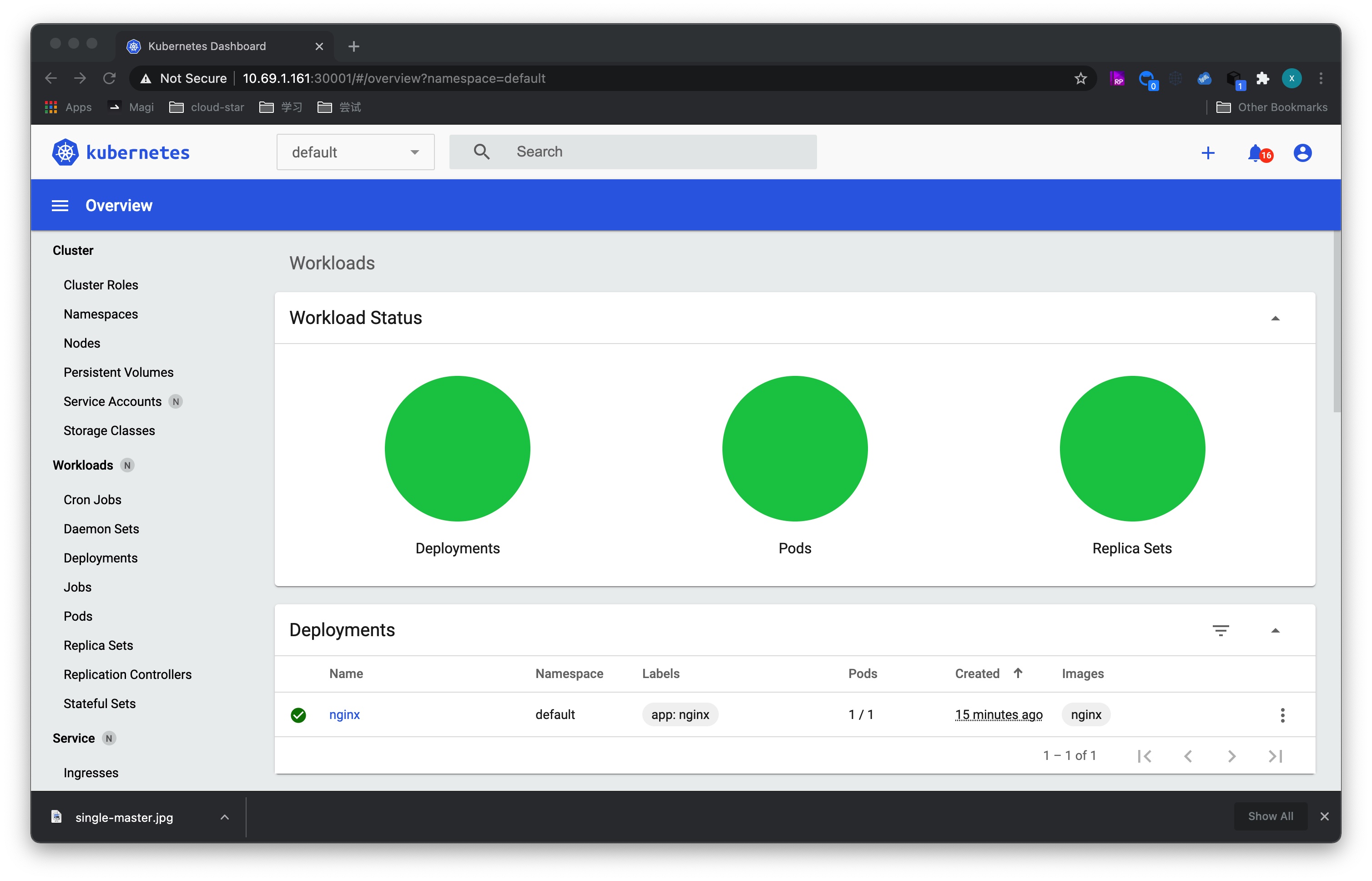

# 8. 部署 Dashboard

若yaml下载不下来,可以直接用浏览器打开,拷贝内容,在服务器上创建文件即可

$ wget https://raw.githubusercontent.com/kubernetes/dashboard/v2.0.3/aio/deploy/recommended.yaml

默认Dashboard只能集群内部访问,修改Service为NodePort类型,暴露到外部:

$ vi recommended.yaml

...

kind: Service

apiVersion: v1

metadata:

labels:

k8s-app: kubernetes-dashboard

name: kubernetes-dashboard

namespace: kubernetes-dashboard

spec:

ports:

- port: 443

targetPort: 8443

nodePort: 30001

selector:

k8s-app: kubernetes-dashboard

type: NodePort

...

$ kubectl apply -f recommended.yaml

$ kubectl get pods -n kubernetes-dashboard

NAME READY STATUS RESTARTS AGE

dashboard-metrics-scraper-6b4884c9d5-gl8nr 1/1 Running 0 13m

kubernetes-dashboard-7f99b75bf4-89cds 1/1 Running 0 13m

访问地址:https://NodeIP:30001

创建service account并绑定默认cluster-admin管理员集群角色:

# 创建用户

$ kubectl create serviceaccount dashboard-admin -n kube-system

# 用户授权

$ kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kube-system:dashboard-admin

# 获取用户Token

$ kubectl describe secrets -n kube-system $(kubectl -n kube-system get secret | awk '/dashboard-admin/{print $1}')

使用输出的token登录Dashboard。

成功!!!

# 9. 切换容器引擎为Containerd

- 由于k8s即将启用docker容器引擎,所以这里给出切换到containerd容器引擎的一个解决方案。

- 目前不切换容器引擎也是可以正常使用的,大概是在k8s1.23版本的时候,会正式弃用docker。

- 不管使用什么容器引擎,对于使用k8s命令或者说是学习k8s,都是没有任何差异的。

- 切换容器引擎需要逐个调整各个节点,也可实现逐步升级。部分调整,部分不调整,也可以正常使用。

1、配置先决条件

$ cat <<EOF | sudo tee /etc/modules-load.d/containerd.conf

overlay

br_netfilter

EOF

$ sudo modprobe overlay

$ sudo modprobe br_netfilter

# 设置必需的 sysctl 参数,这些参数在重新启动后仍然存在。

$ cat <<EOF | sudo tee /etc/sysctl.d/99-kubernetes-cri.conf

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.ip_forward = 1

net.bridge.bridge-nf-call-ip6tables = 1

EOF

# Apply sysctl params without reboot

$ sudo sysctl --system

2、安装containerd

$ yum install -y yum-utils device-mapper-persistent-data lvm2

$ yum-config-manager \

--add-repo \

https://download.docker.com/linux/centos/docker-ce.repo

$ yum update -y && sudo yum install -y containerd.io

$ mkdir -p /etc/containerd

$ containerd config default | sudo tee /etc/containerd/config.toml

$ systemctl restart containerd

3、修改配置文件

$ vi /etc/containerd/config.toml

[plugins."io.containerd.grpc.v1.cri"]

sandbox_image = "registry.aliyuncs.com/google_containers/pause:3.2"

...

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.runc.options]

SystemdCgroup = true

...

[plugins."io.containerd.grpc.v1.cri".registry.mirrors."docker.io"]

endpoint = ["https://b9pmyelo.mirror.aliyuncs.com"]

$ systemctl restart containerd

4、配置kubelet使用containerd

$ vi /etc/sysconfig/kubelet

KUBELET_EXTRA_ARGS=--container-runtime=remote --container-runtime-endpoint=unix:///run/containerd/containerd.sock --cgroup-driver=systemd

$ systemctl restart kubelet

5、验证(注意如果是切换master节点的容器引擎,需要注意可能要等待几分钟,等待kubelet重启)

$ [root@liuxiaolu-master ~]# kubectl get node -o wide

NAME STATUS ROLES AGE VERSION INTERNAL-IP EXTERNAL-IP OS-IMAGE KERNEL-VERSION CONTAINER-RUNTIME

liuxiaolu-master Ready control-plane,master 26h v1.21.0 xx.xx.x.xxx <none> CentOS Linux 7 (Core) 3.10.0-957.el7.x86_64 containerd://1.4.4

liuxiaolu-node Ready <none> 25h v1.21.0 xx.xx.x.xxx <none> CentOS Linux 7 (Core) 3.10.0-957.el7.x86_64 containerd://1.4.4

PS: CONTAINER-RUNTIME显示为containerd://1.4.4即为成功